Có thể bạn chưa biết: Trí tuệ nhân tạo ChatGPT cần 'uống nước' để trả lời câu hỏi

Theo Tổ Quốc | 12/09/2023 04:46 PM

(Tổ Quốc) - Với một hệ thống AI tổng quát hiệu năng cao như ChatGPT, việc vận hành không chỉ tiêu tốn nhiều điện năng, mà còn yêu cầu lượng nước khổng lồ.

Trước sự phát triển vũ bão của công nghệ, chúng ta thường nói vui với nhau rằng “hiện đại thì hại điện”. Tuy nhiên, với một hệ thống AI tổng quát hiệu năng cao như ChatGPT, việc vận hành không chỉ tiêu tốn nhiều điện năng, mà còn yêu cầu lượng nước khổng lồ.

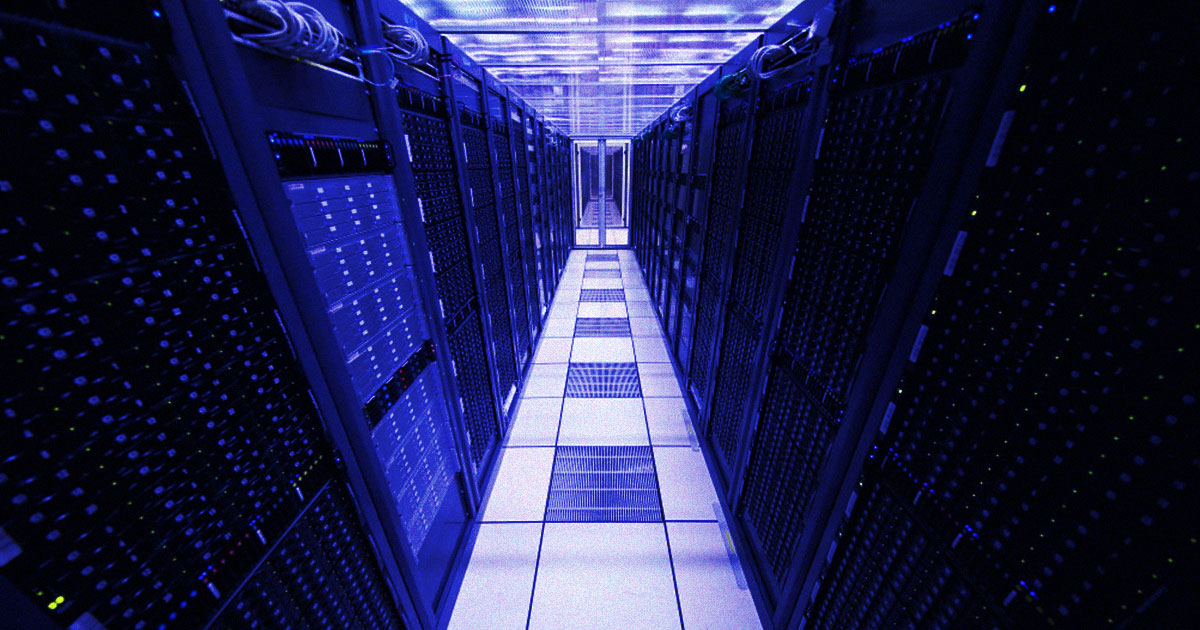

Các nghiên cứu gần đây đã cho thấy trung tâm dữ liệu vận hành ChatGPT đòi hỏi lượng nước làm mát rất lớn để đảm bảo duy trì hoạt động ổn định cho hệ thống AI, với hàng tỷ câu hỏi do người dùng đưa ra liên tục theo thời gian thực.

Theo nhà nghiên cứu Shaolei Ren đến từ Đại học California, ChatGPT và các mô hình LLM tương tự sử dụng tới 500ml nước sạch cho mỗi cuộc trò chuyện gồm từ 20 tới 50 câu hỏi với người dùng. 500ml nghe có vẻ không nhiều, nhưng với việc người dùng trên toàn cầu cùng sử dụng ChatGPT thì lượng nước tiêu hao là rất lớn.

Trong một nghiên cứu tổng quát khác được tiến hành bởi các chuyên gia tại Đại học Colorado Riverside và Đại học Texas (Hoa Kỳ), một lượng lớn khổng lồ đang được sử dụng để làm mát trung tâm dữ liệu vận hành các hệ thống AI trên toàn thế giới, góp phần tạo ra tác động không nhỏ đối với môi trường.

Nhóm nghiên cứu chỉ ra rằng các trung tâm dữ liệu điển hình của Microsoft và OpenAI tại Mỹ sử dụng hơn 700.000 lít nước trong quá trình huấn luyện mô hình GPT-3, tương đương với lượng nước đủ làm mát một lò phản ứng hạt nhân. Thậm chí, một hình AI năng lực cao khác như LaMDA của Google có thể tiêu thụ một lượng nước “đáng kinh ngạc” lên tới hàng triệu lít. Con số này có thể tăng cao hơn lần nếu quá trình huấn luyện diễn ra tại trung tâm dữ liệu quy mô lớn hơn ở châu Á.

Các trung tâm này sử dụng hệ thống làm mát bằng không khí và tản nhiệt nước kết hợp. Cả hai đều cần lượng lớn nước sạch để tránh tình trạng ăn mòn và vi khuẩn gây tắc ống dẫn, một phần nước sẽ bị tiêu hao khi bốc hơi tại những tháp làm mát.

Microsoft và OpenAI đã thừa nhận vấn đề này, đồng thời cho biết đang nghiên cứu các cách thức đo lường mức sử dụng năng lượng và lượng khí thải carbon của tương ứng. Công ty cũng khẳng định đang tìm phương án tối ưu để làm việc duy trì các hệ thống LLM tiêu tốn ít năng lượng hơn.